La conception très ambiguë de l’égalité de Google

L’IA (Intelligence artificielle) engendre de nouveaux modes de collaborations entre l’homme et la machine. Cet article s’inscrit dans une série destinée à explorer les modalités d’une collaboration idéale entre l’homme et la machine. Dans cette chronique, une première intelligence artificielle est passée au crible de la matrice proposée dans l’article inaugural de cette série.

La mission de Google consiste à « organiser les informations à l’échelle mondiale pour les rendre accessibles et utiles à tous » (source : Google.fr). Ainsi, Google laisse volontiers croire à chacun que nous serions désormais tous égaux face à l’information. D’ailleurs, son algorithme y travaille sans conteste. Mais pourtant, rien n’est moins évident.

En effet, prenons deux individus : Benoît et Nathalie. Benoît est né dans les beaux quartiers et vient d’entrer à l’université de Harvard après un brillant cursus d’ingénieur. Nathalie, quant à elle, vient d’un milieu plus modeste et, à force de courage, elle fait la fierté de ses parents qui n’ont pas le bac, en ayant été admise à l’IUT d’informatique de la plus grand ville de la région avoisinant le petit village où elle est née. Et l’anglais n’est pas son fort.

Benoît et Nathalie se passionnent l’un comme l’autre pour l’intelligence artificielle. Lorsqu’ils effectuent une recherche à ce sujet dans Google, ils s’y prennent différemment. Benoît tape « Artificial Intelligence » (en anglais) sachant bien que les labs des universités américaines comme le MIT ou Stanford sont à la pointe sur le sujet. Il cliquera d’ailleurs uniquement sur des liens l’orientant vers des sites, en anglais, de centres de recherches prestigieux qu’il connaît. L’algorithme de Google le comprendra et continuera par la suite à lui pousser toujours plus de sites de qualité et en anglais, à chacune de ses nouvelles recherches. De son côté, Nathalie a vaguement entendu parler du MIT et de son Media Lab, mais effectue la requête « Intelligence artificielle » (en français) puis clique sur des liens la conduisant sur des sites en français. Ce faisant, elle invite Google à ne pas lui proposer des sites en anglais (qui pour certains fournissent pourtant des articles sur l’intelligence artificielle lisibles, même par un français allergique à l’anglais).

Certes l’algorithme de Google se montre obéissant, mais est loin de respecter plusieurs des critères mentionnés antérieurement. A titre d’exemple, il ne prend pas en compte le fait que les données sur lesquelles il s’appuie peuvent être biaisées (critère 8). Or ici, Nathalie met l’algorithme de Google sur un mauvais chemin en l’orientant vers le français. Par ailleurs, si Google tient compte des requêtes similaires des autres utilisateurs, il ne donne pas clairement à Benoît l’occasion de comparer sa collaboration avec Google avec d’autres binômes hommes-machines (critère 5). Plus fondamentalement encore, nous sommes loin de viser une asymétrie de l’information proche de zéro (critère 12).

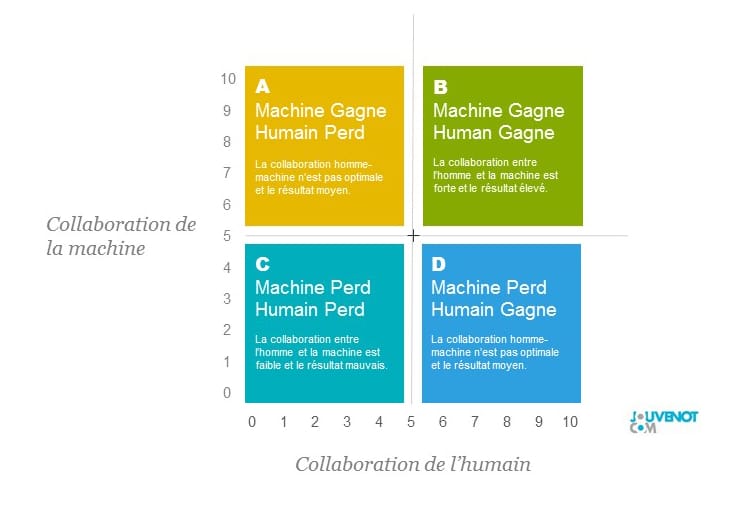

Google occupera donc une place dans le carré A de la matrice.

A suivre